📝 ニュースの要約ポイント

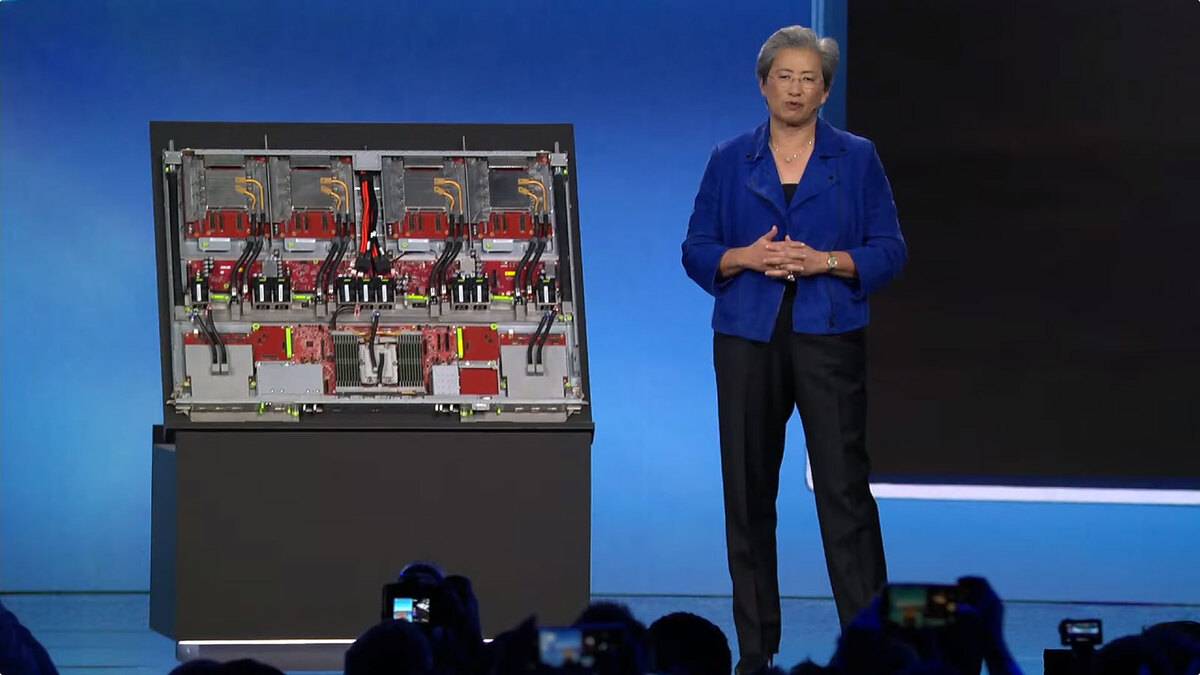

- AMDはCES 2026で、NVIDIA Rubin対抗となる最先端AIラック「Helios」の実機を披露。2025年10月発表のOCP Double-Wide Rack(ORW)を採用し、大規模AI処理に最適化された広大なスペースが特徴です。

- MI455X GPUを4基、Veniceインターコネクト、そしてUAL(Ultra Accelerator Link)ベースのVulcanoスイッチを12基(6枚分)搭載。HPE JuniperとBroadcomの技術を活用したUALoE(UAL over Ethernet)による高速なScale-up/outネットワークが、前例のないAI演算性能を可能にします。

- Heliosは、AI市場におけるNVIDIAの優位性に対抗するAMDの切り札であり、オープン規格の採用と高い電力効率・冷却性能で、データセンターや研究機関が直面するAIインフラの課題解決に貢献。将来の自作PCの進化にも繋がる技術トレンドを示します。

CES 2026の主役、AMD最先端AIラック「Helios」がついにベールを脱ぐ

今年のCES 2026でAMDが発表した「Helios」は、AI業界に大きな衝撃を与えています。AIの進化が日進月歩で進む中、その土台となるインフラの競争も激化の一途を辿っています。NVIDIAが先行するAIアクセラレーター市場に対し、AMDが満を持して投入するHeliosとは一体どのような製品なのでしょうか。本記事では、初心者にも分かりやすく、しかし玄人も唸る深掘り解説で、その全貌に迫ります。

「Helios」とは何か? 大規模AIを支えるラックベースソリューション

Heliosは、NVIDIAのRubinに対抗するAMDのラックベースAIソリューションです。簡単に言えば、AIの学習や推論を高速に行うための超高性能なコンピューターの塊が、一つの大きな棚(ラック)に集約されているイメージです。私たちが普段使うPCの性能を何万倍にも引き上げたような、想像を絶する処理能力を持つシステムと言えるでしょう。

OCP Double-Wide Rack(ORW)採用の意義

Heliosの最大の特徴の一つが、OCP(Open Compute Project)の「Double-Wide Rack(ORW)」を採用している点です。従来のサーバーラックのほぼ2倍の幅を持つこのORWは、Metaが2025年10月に発表したばかりの最新規格。なぜ幅広のラックが必要なのでしょうか?

それは、AIチップが高性能化するにつれて発熱が大きくなり、冷却や電力供給のためのスペースがより多く必要になるからです。ORWの採用は、これらの課題を解決し、将来のさらなる性能向上にも対応できる柔軟性をもたらします。NVIDIAのVera Rubin Compute Trayと比較しても、Heliosのシャーシには「かなりのゆとりがある」とされており、これは液体冷却の配管などを考慮した場合の設計余裕を示唆しています。このゆとりが、安定稼働とメンテナンス性の向上に大きく貢献するはずです。

革新的な内部構造:MI455Xと超高速ネットワークの連携

Heliosの心臓部となるのは、AMDの最新AIアクセラレーター「MI455X」です。シャーシにはこのMI455Xが4基、さらにVeniceインターコネクト、Vulcanoが12基(カードとしては6枚)、Salinaが1基収められています。これらのコンポーネントが密接に連携し、途方もないAI処理能力を生み出します。

MI455XとVenice:演算能力のコア

MI455XはAIの計算を担うGPUチップであり、これらがVeniceインターコネクトを通じて高速に連携します。Veniceは、MI455X間のデータ転送を最適化し、まるで一つの巨大なGPUのように機能させるための重要な役割を果たすでしょう。従来のInfinity Fabricによる接続に加え、VeniceがPCIe Gen6 x16でVulcanoやSalinaとつながることで、より広範なデータ連携が実現されます。これは、GPU間の通信だけでなく、外部ストレージや他の計算ノードとのデータ交換においても、ボトルネックを最小限に抑えるための重要な進化です。

UALoEが切り拓く新時代のネットワーク

Heliosのもう一つのハイライトは、Scale-up(ラック内での各コンポーネント間の連携)に「UAL(Ultra Accelerator Link)」、特に「UALoE(UAL over Ethernet)」を利用する点です。これは、HPE Juniper NetworkingとBroadcomのTomahawk 6チップが開発に貢献しているオープン規格であり、従来のネットワーク技術では難しかった超高速なデータ転送を可能にします。シャーシあたり800G×6という驚異的な帯域幅は、AIモデルの学習におけるボトルネックを解消し、演算能力を最大限に引き出す鍵となります。

特筆すべきは、VulcanoスイッチがPCIeとUALインターフェースを持つため、MI455Xに直接接続するのではなく、Veniceを介して接続されると予測される点です。これにより、柔軟なネットワーク構成と高い拡張性が確保されると考えられます。また、ラック間のScale-out(複数のラックを連携させる)には400Gイーサネットがシャーシあたり1本提供され、大規模なデータセンター全体でのAI処理を強力にサポートします。このオープン規格ベースのアプローチは、NVIDIAのクローズドなNVLinkエコシステムに対するAMDの差別化戦略と言えるでしょう。

なぜ今、AMDはHeliosを投入するのか? 市場への影響と自作PCの未来

AI技術が急速に進展する現代において、AIチップとそれを支えるインフラの需要は爆発的に増加しています。NVIDIAが「CUDA」エコシステムと強力なハードウェアで市場をリードする中、AMDはHeliosを投入することで、AI市場における自身の存在感を一層高めようとしています。

データセンターと研究機関へのメリット

Heliosは、大規模なAIモデルの学習や推論を行うデータセンター、研究機関、企業にとって大きなメリットをもたらします。高い演算性能はもちろんのこと、オープン規格のORWやUALoEを採用することで、特定のベンダーに依存しない柔軟なインフラ構築が可能になります。これは、システムの導入コストだけでなく、長期的な運用コストや将来的な拡張性においても有利に働くでしょう。また、冷却や電力効率にも配慮された設計は、高騰するデータセンターの電力消費を抑制し、サステナビリティへの貢献も期待されます。

AIエコシステムの競争促進

AMDのHeliosのような強力な対抗馬の登場は、AIアクセラレーター市場の競争をさらに激化させます。競争があるからこそ、技術革新は加速し、製品の性能向上や価格競争が促されます。これにより、最終的にはAI技術を利用する私たちユーザーにとっても、より高性能で効率的なAIサービスが提供されることに繋がります。選択肢が増えることは、イノベーションの活性化に不可欠です。

自作PCユーザーへの示唆

一見、遠い存在に思える大規模データセンター向けのAIラックですが、ここで培われる最先端の技術は、将来的に私たちの自作PCにも降りてくる可能性があります。例えば、PCIe Gen6やUALのような高速インターフェースの発展は、将来のグラフィックボードやSSDの性能向上に直結します。

また、AIアクセラレーターがますます高性能化し、それらを効率的に接続・冷却する技術は、いずれ個人向けの高性能ワークステーションや、私たちのPCに搭載されるCPUやGPUの設計にも影響を与えていくでしょう。AIの民主化が進むにつれて、データセンターで培われた技術が、より身近なデバイスへとスケールダウンされていく姿は、ITガジェット好きにとって非常に興味深い未来を示唆しています。

まとめ:Heliosが描くAMDのAI戦略と未来像

AMDのAIラックHeliosは、単なる高性能AIコンピューターの集合体ではありません。ORW、MI455X、Venice、そしてUALoEといった最先端技術の融合により、AMDはAIインフラの新たな標準を打ち立てようとしています。これは、AI分野におけるNVIDIAへの挑戦状であると同時に、オープンで高性能なAIインフラの普及を目指すAMDの強い意志を示しています。

AIは私たちの社会を根本から変えようとしていますが、その進化の速度は、それを支えるインフラの性能にかかっています。HeliosがAI業界にどのような変革をもたらすのか、2026年のCESでの実機披露が今から楽しみです。AMDのAI戦略の次の一手に、今後も目が離せません。

出典: ASCII.jp:CES 2026で実機を披露! AMDが発表した最先端AIラックHeliosの最新仕様を独自解説 (1/3)

コメント